Clarisse Sieckenius de Souza é professora titular do Departamento de Informática da PUC-Rio. Tem Bacharelado e Mestrado em Letras pela PUC-Rio e Doutorado em Linguística Aplicada. Desenvolve sua pesquisa sobre Interação Humano-Computador e é desenvolvedora da teoria da Engenharia Semiótica.

USINA: A inteligência artificial pode ser entendida como muitas coisas. No imaginário popular parece muitas vezes recair sobre ideias equivocadas e fantasiosas. Mesmo para os que trabalham com isso parece haver uma certa dificuldade de apontar os limites do tema. Para as pessoas que trabalham na área, o que poderia ser uma definição mínima de uma inteligência artificial?

Clarisse: Há uma diversidade grande de “pessoas que trabalham na área”. A Inteligência Artificial (IA) historicamente atrai a atenção de pessoas vindas de muitas disciplinas distintas, de Computação a Filosofia, de Lógica a Psicologia, de Engenharia a Linguística, e mais. Além disto, o tipo de trabalho de cada um pode ser mais voltado para a pesquisa, ou mais voltado para o desenvolvimento de aplicações, e hoje em dia inclusive voltado para o Direito, com a legislação sobre uso de dados que avança na Europa e já também no Brasil. Esta multiplicidade de perspectivas torna muito difícil chegar a uma definição mínima. Mas, arriscando uma delas, usaria a antiga definição de Nils Nilsson, para quem a inteligência artificial é um tipo de máquina (ou programa) capaz de fazer coisas que normalmente requerem inteligência humana para se fazer.

USINA: O que faz linguagens de computador linguagens? O que é preciso para chamar algo de língua? É possível tradução entre linguagens de computador?

Clarisse: Linguagem, formalmente falando, é qualquer sistema de símbolos que tem um vocabulário definido, regras de combinação entre palavras deste vocabulário, e regras de atribuição de significado, tanto para vocábulos quanto para combinações entre eles. Neste sentido, as “linguagens de computador” são todas legítimas linguagens. O que é especial é a “linguagem humana” (ou as “línguas humanas”, como alguns preferem). Uma língua humana também é um sistema de símbolos, com tudo que as linguagens de computador têm, e mais. Eu poderia destacar três aspectos importantes da linguagem humana, numa comparação com as linguagens computacionais. O primeiro é o fato de que as regras de interpretação (e também parte das de formação) de sentenças e textos nas línguas humanas são estabelecidas por convenções sócio-culturais. As das linguagens de computador são estabelecidas pelo desejo de quem as cria. Para ilustrar a diferença, se você ou eu quisermos criar uma linguagem de computador e usá-la na comunicação entre máquinas e pessoas, basta que tenhamos competência técnica para tanto. Já se você ou eu quisermos criar uma língua humana, por mais profundamente que conheçamos a linguagem humana, milênios de história nos mostram que não vamos conseguir. As línguas humanas são um fenômeno social de larga escala, muito além da vontade e competência técnica individual que bastam para criar linguagens de computador.

O segundo aspecto importante das línguas humanas é o seu papel evolutivo, até por força de sua origem sócio-cultural. As línguas humanas evoluem, como organismos vivos, em direções que não podemos controlar. Já uma linguagem de computador pode até evoluir (por exemplo, temos o Java 7 e o Java 8, duas versões subsequentes da mesma linguagem de programação). Porém, apesar de haver, com certeza, componentes da prática social de programação que influenciam o aparecimento de versões evolutivas de uma linguagem computacional, a evolução não se efetiva a menos que se “determinem” quais são os novos símbolos, regras, etc. Nas línguas humanas não temos como determinar voluntariamente uma evolução.

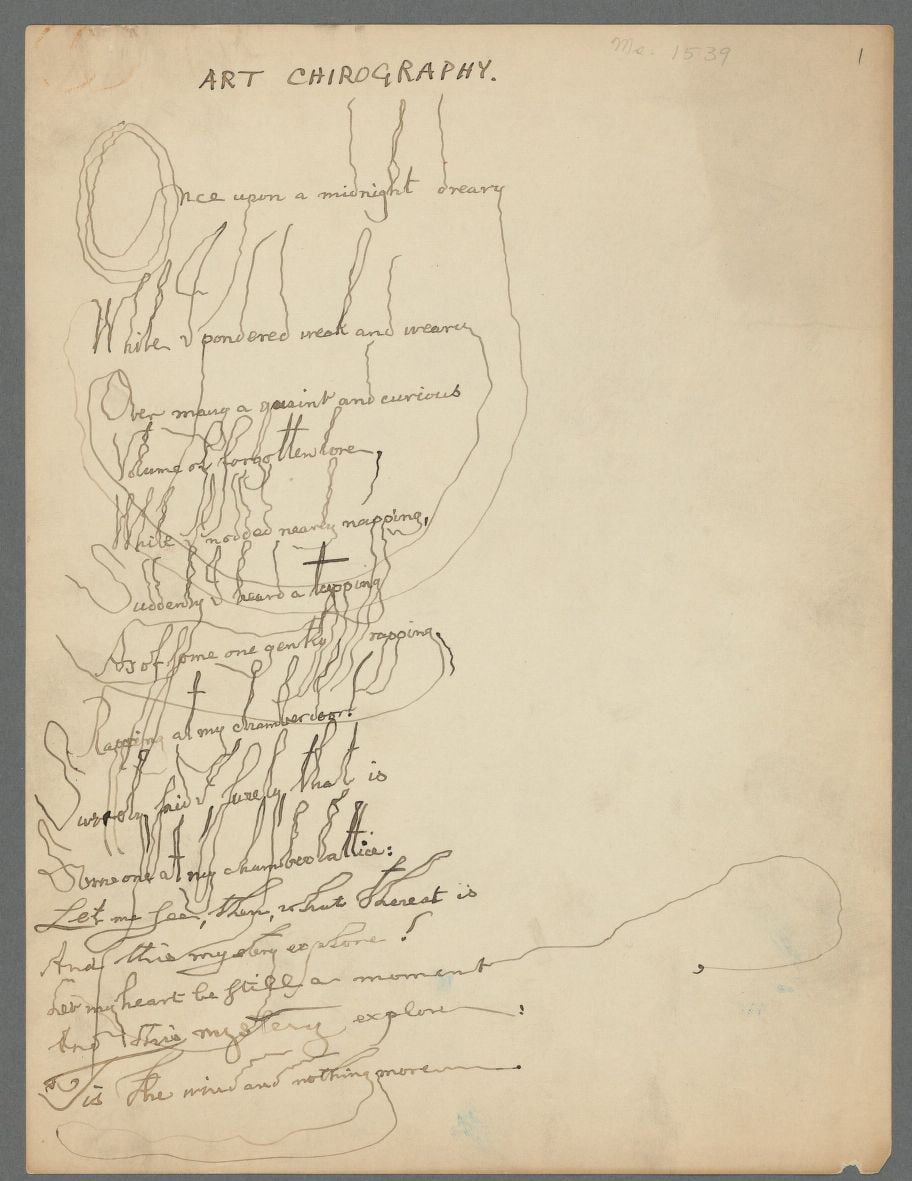

Finalmente o aspecto mais interessante da linguagem humana é a natureza da sua relação com a mente, tanto em termos cognitivos, quanto intencionais e emocionais. Por exemplo, é através da linguagem que podemos construir e imaginar coisas que não existem, ou que não são verdade. É com a linguagem que podemos “fazer arte” (da piada à poesia, passando também pelo engodo, é bom lembrar). No caso de linguagens computacionais, o elo entre linguagem e pensamento/raciocínio – indo direto ao ponto da IA – é bastante empobrecido. Mihai Nadin, semioticista e cientista da computação, insiste em um ponto que ilustra bem os limites computacionais. Diz ele que os computadores, ao contrário das pessoas, não têm a capacidade de imaginar (ou de “antecipar”) coisas, mas apenas de “prevê-las”. A diferença entre previsão e antecipação aparece quando vemos que previsões são feitas com base em modelos estatísticos ou causais, por exemplo, enquanto que o que imaginamos ou “antecipamos”, vem, em sua maior parte, das nossas emoções (desejos e medos), intuições e ponto de observação da realidade, enriquecidos (embora não necessariamente) por probabilidades e causalidades que conhecemos. Ou seja, a nossa linguagem humana nos permite ‘inventar realidades’ e estabelecer, com a própria linguagem, regras e convenções para interpretá-las, reagir a elas, e usá-las. Computacionalmente, esta capacidade é, na melhor das hipóteses, muitíssimo limitada.

Como as linguagens computacionais têm vocabulário, gramática e regras de interpretação sempre estipuladas e conhecidas, a tradução entre elas é possível (excetuadas algumas tecnicalidades que não precisamos abordar aqui). Em alguns casos até muito fácil fazer isto, inclusive mecanicamente. Pela mesma razão também é relativamente fácil traduzir um texto em linguagem de computador para uma linguagem humana. O que não é fácil (e, até onde se sabe, nem possível) é a tradução de uma língua humana para uma linguagem computacional.

USINA: Você poderia falar um pouco sobre o conceito de ontologia na inteligência artificial?

Clarisse: Muito se fala em Ontologias na área de Computação em geral, mas comumente com um significado bem diferente do que o termo tem na sua disciplina de origem, a Filosofia. As “ontologias” usadas em Computação são uma espécie de sistema conceitual de referência que “guia” a formação ou aplicação de regras de atribuição de significado (a semântica) de modelos e linguagens computacionais. Estas ontologias são importantes porque são elas que permitem, por exemplo, as “traduções” entre linguagens de representação de conhecimentos na IA. É através delas que podemos descobrir se há correspondências entre o significado de vocábulos e sentenças em uma e outra, quais são elas, e – com isto – como efetuar a tradução. Recentemente encontrei um estudo de pesquisadores suecos dizendo que, em Informática, as ontologias são “prescritivas”. Achei a colocação muito feliz, pois não apenas sublinha esta questão pragmática de as ontologias serem usadas, na Computação, para normatizar e guiar computações, como também deixa evidente a diferença para o que o termo quer dizer na Filosofia.

USINA: Quais você acha que são as principais questões éticas envolvendo IA hoje em dia?

Clarisse: A que mais me chama a atenção é a lentidão (senão a recusa, em muitos casos) das pessoas que trabalham no chamado ‘núcleo duro’ da computação, parte mais próxima da matemática e da lógica, em admitir que os modelos abstratos que elas criam não são neutros em relação a seus valores, motivações, contextos e histórias pessoais. De maneira geral, o uso da matemática e da lógica muitas vezes serve de escudo para os pesquisadores que atuam no núcleo duro da computação acharem que o que fazem não tem nada de subjetivo, nada de cultural e socialmente determinado, nada a ver com o que a computação faz hoje na vida das pessoas, em escala individual, social, ou até planetária. O fosso que separa a teoria da computação, de um lado, e suas aplicações, do outro, me parece ser um enorme entrave ético para uma discussão produtiva sobre IA, pois permite que os pesquisadores escolham, por conveniência, se querem ou não atentar para os aspectos sociais de sua pesquisa. Os que pendem para o lado teórico podem achar-se isentos (embora muitos não o façam, louvavelmente), ao passo que os que pendem para o lado aplicado devem achar-se comprometidos (embora alguns não o façam, lamentavelmente).

USINA: Como lidar com a questão de IAs e softwares que apresentam vieses machistas ou racistas?

Clarisse: Acho que o primeiro passo é vencer o fosso entre teoria e suas aplicações de que falei anteriormente. É primeiramente, então, uma questão de mudança de atitude. Se vencermos este passo, o segundo seria nos dedicarmos seriamente a desenvolver ferramentas computacionais capazes de rastrear a codificação de valores e crenças culturalmente determinados (desejáveis e indesejáveis) em programas e dados computacionais. Estas ferramentas não existem ainda. Há propostas incipientes para a criação de algumas delas, mas quando falo em “ferramentas disponíveis” penso em algo que poderíamos ensinar a todo aluno de graduação dos cursos que formam profissionais de Informática. Este seria o passo definitivo. Até lá, mudança de atitude e muita pesquisa. Temos de adicionar a esta perspectiva interna à Computação, medidas na perspectiva externa: legislação inteligente e eficaz, agentes públicos capazes de garantir o cumprimento das leis, e – sempre – no plano da educação, a formação do cidadão para o exercício da cidadania responsável no que diz respeito ao mundo digital.

USINA: Como a semiótica de Charles Peirce, que você usa no seu trabalho, pode contribuir para o campo da IA?

Clarisse: Muitas notas biográficas sobre Charles Peirce se referem a ele como um “polímata”, uma pessoa cujos conhecimentos abrangem um vasto (no caso de Peirce vastíssimo) território disciplinar e intelectual. O resultado disto tem duas facetas notáveis. Uma é que a teoria Peirceana é multi-conectada. Em certos momentos parece até que ‘tudo tem a ver com tudo’, tamanha a profundidade e a extensão das relações entre os temas e conceitos de que ele trata. A outra faceta é que a teoria Peirceana é extremamente difícil. Há vários ‘exegetas’ dela, que nos ajudam a nos aproximarmos da sua essência. Porém, ela é muito complexa. Apesar disto, ela é não apenas fascinante, pela sua capacidade de ligar pontos da realidade que outras teorias não ligam, mas também uma fonte muito rica de inspiração para unificar modelos de conhecimento necessários na ação de robôs inteligentes, por exemplo.

Pessoalmente, acho que o ponto mais poderoso da teoria Peirceana para a IA é a sua lógica abdutiva, uma espécie de raciocínio provisório, cujos mecanismos são justamente aqueles que nos dão acesso ao imaginário, àquilo que não necessariamente é fato ou verdade, mas que para todos os efeitos práticos imediatos parece ser e funcionar na situação em que estamos. Este tipo de raciocínio caracteristicamente humano é o que nos faz dar grandes saltos quase às escuras, e andar rápido em trilhas onde um computador utilizando lógica dedutiva ou mecanismos indutivos poderia travar e não ir a lugar nenhum. Frequentemente estes saltos nos levam a constatar mais adiante que ‘não era bem assim’, ou seja, que o que achávamos que era verdade tem exceções ou detalhes que desconhecíamos e podem até nos custar caro. Mas o fato é que vamos em frente com este tipo de raciocínio, enquanto a IA que seguiria modelos estritamente probabilísticos ou até lógicas mais ou menos clássicas, poderia ficar parada ou seguir numa direção completamente improdutiva.

Se pudermos criar modelos computacionais mais próximos do que propõe a lógica abdutiva de Peirce, acho que poderemos avançar bastantes em várias frentes da IA.

USINA: Por último, o que você acha das pessoas que imaginam um futuro controlado por inteligências artificiais? Você acha que os robôs vão dominar o mundo?

Clarisse: Acho que os computadores já dominam extensamente o nosso mundo, não? Tem gente até indo para SPA de desconexão para tentar encontrar um espaço onde os efeitos dos sistemas computacionais não as atinjam! O problema de sermos dominados por computadores, a meu ver, já existe e temos de nos defender cotidianamente dos erros e abusos daqueles que, informados por ou por meio de um sistema computacional, roubam nossos dados, invadem a nossa privacidade, bloqueiam o exercício dos nossos direitos, espalham notícias mentirosas, incitam e cometem crimes, esquivam-se da lei, e por aí vai. Acho que temer que “no futuro” seremos dominados por IA pode talvez nos tirar a chance de perceber que, se temos alguma escolha, não é a de não virmos a ser dominados (pois já o somos), mas a de colocar imediatamente, no presente, esta questão no centro do debate e das ações relativas aos limites das responsabilidades e direitos civis de quem produz e de quem usa tecnologias digitais, de qualquer tipo que seja. Não são as máquinas que nos dominam, mas aqueles que se servem delas, direta ou indiretamente, consciente ou inconscientemente, devida ou indevidamente, para alcançar os seus propósitos. Há movimentos muito claros tomando vulto para realizar este debate e criar proteções para a sociedade, o que é uma boa notícia. Vamos apoiá-los!